AI Must Embrace Specialization via Superhuman Adaptable Intelligence

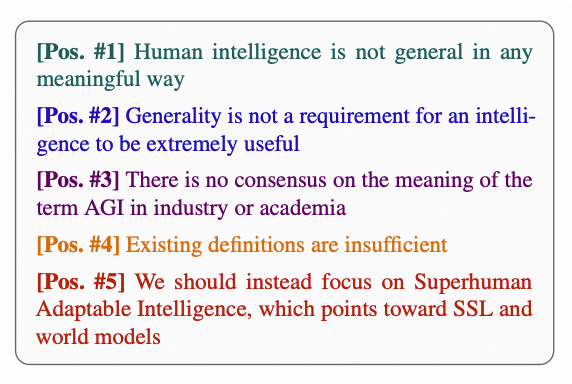

TL;DR

Yann LeCun 出了名的反对大语言模型路线,最近他牵头发表的这份论文认为:人类智能从来就不是「通用」的,它只是在进化压力下高度特化的产物。因此,以「人类水平的通用智能」为目标的 AGI 概念本身就存在逻辑矛盾和定义混乱。文章提出了一个替代框架「超人类适应性智能(Superhuman Adaptable Intelligence, SAI)」:AI 不必追求无所不能,而应追求在任何重要任务上快速适应并超越人类,同时也能拓展到人类能力之外的领域。衡量标准也随之改变:不再是「能做多少事」,而是「学会一件新事有多快」。

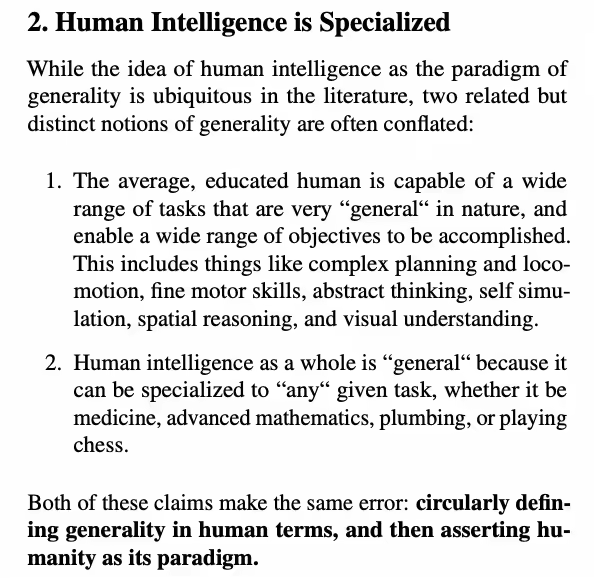

人类真的「通用」吗?

论文开篇就抛出了一个不太客气的判断(暴论):人类智能根本不是通用的。 我们总觉得自己什么都能学、什么都能做,但论文指出,这更多是一种认知盲区带来的错觉。人类擅长的那些事情——行走、抓取、社交推理、空间感知——恰恰是几百万年进化压力筛选出来的生存技能。而一旦离开这个进化塑造的「舒适区」,我们的表现其实相当有限。 论文举了一个很直观的例子:国际象棋。Magnus Carlsen 被公认为史上最伟大的棋手,但和现代计算机程序相比,他的水平其实差距悬殊——而且写一个比他强得多的象棋程序在今天并不是什么难事。我们之所以觉得 Carlsen「很厉害」,只是因为我们拿他和其他人类比。这就是所谓的 Moravec 悖论的另一面:我们觉得容易的事(比如走路)对计算机很难,而我们觉得难的事(比如下棋)对计算机反而很简单。 所以论文的第一个核心论点是:把「通用」这个词挂在人类智能上,本身就是一种自我中心的错觉。人类不是通用的,人类是在特定生态位上高度适应的。

AGI:一个被用坏了的词

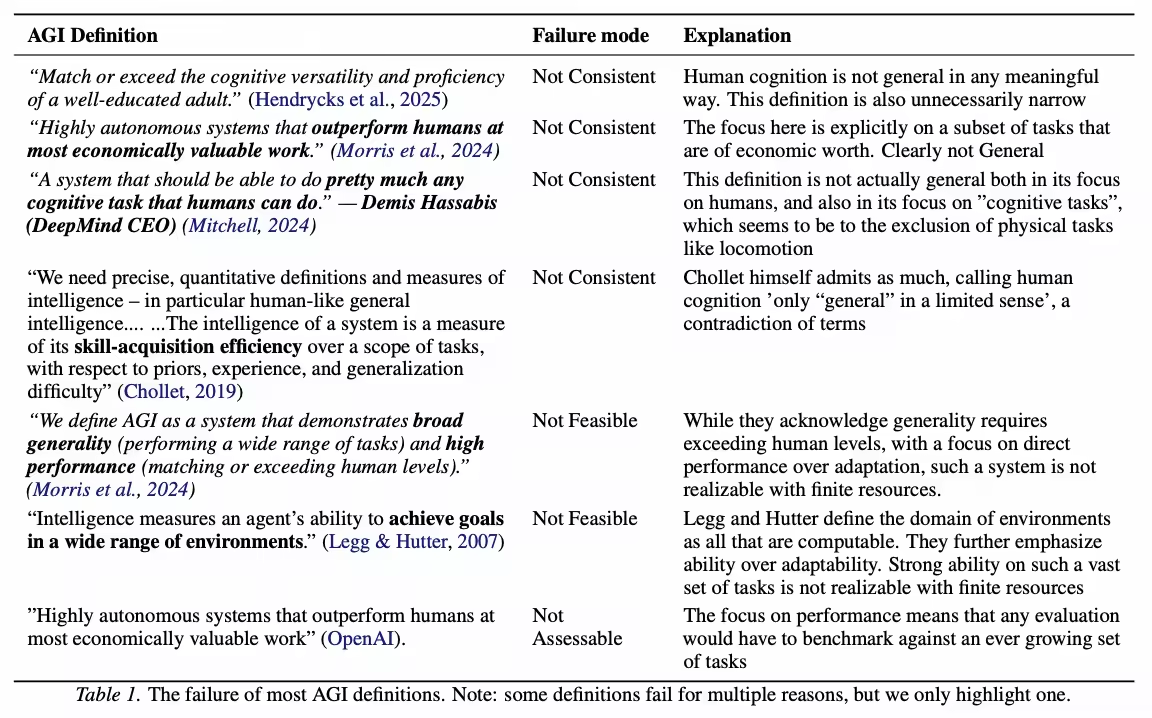

论文接下来花了不少篇幅讨论 AGI 这个概念的混乱现状。作者梳理了业界和学界常见的 AGI 定义,发现它们大致沿着两个轴分布:一个是「能力来源」(是能直接做,还是能学会做),另一个是「任务范围」(是所有可计算的任务,还是人类能做的任务,还是有经济价值的任务)。 问题在于,不同的人用 AGI 这个词的时候,指的是完全不同的东西。有人说的是图灵完备意义上的「能计算任何可计算函数」,有人说的是「能做大多数有经济价值的工作」,还有人说的是「能像受过教育的成年人一样认知」。这些定义之间差异巨大,但大家都叫它 AGI,于是辩论就变成了鸡同鸭讲。 论文对现有定义逐一「体检」,用了三条标准:

- 是否可行(物理和理论上能实现吗)

- 否自洽(说自己是「通用」的就真的通用吗)

- 是否可评估(有没有明确的衡量方式)。

结果大多数定义都至少在一条上不及格。比如,声称覆盖「所有可计算任务」的定义在「No Free Lunch」定理面前站不住脚;以人类为参照的定义又自相矛盾——如果人类本身不通用,那「达到人类水平的通用智能」就是个伪命题。

专精(Specialization)不是缺陷,是优势

这是论文里我觉得写得最有说服力的一段。作者从生物学、经济学和机器学习三个角度论证了为什么专精是必然的、也是更好的策略。

在生物学上,自然选择从不青睐「什么都会一点」的通才,因为在任何一个具体的生态位上,通才都会被专才淘汰。在经济学上,市场机制同样如此——不够专精的公司会被淘汰。在机器学习上,这就是经典的 No Free Lunch 定理和多任务学习中的「负迁移」问题:让一个模型同时学习两个不相关的任务,它在每个任务上的表现往往不如两个分别训练的专用模型。

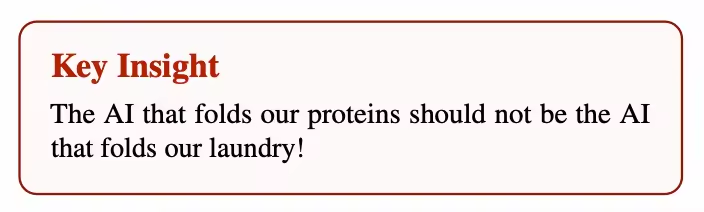

论文用了一句很好记的话来总结:「折叠蛋白质的 AI 不应该是折叠衣服的 AI。」 AlphaFold 之所以能在蛋白质结构预测上取得突破,恰恰是因为它把所有的设计、数据和训练精力都集中在这一个问题上。如果要求同一个系统既能预测蛋白质结构又能叠衣服,两边的性能大概率都会打折扣。

当然,作者也强调这并不意味着「通用能力没有价值」。他们的观点更温和一些:与其抗拒专精,不如拥抱它。即便是那些看起来很「通用」的大模型,内部其实也在通过路由机制和模块化来实现隐式的专精(比如 Mixture of Experts 架构)。

当然,作者也强调这并不意味着「通用能力没有价值」。他们的观点更温和一些:与其抗拒专精,不如拥抱它。即便是那些看起来很「通用」的大模型,内部其实也在通过路由机制和模块化来实现隐式的专精(比如 Mixture of Experts 架构)。

SAI:一个新的北极星?

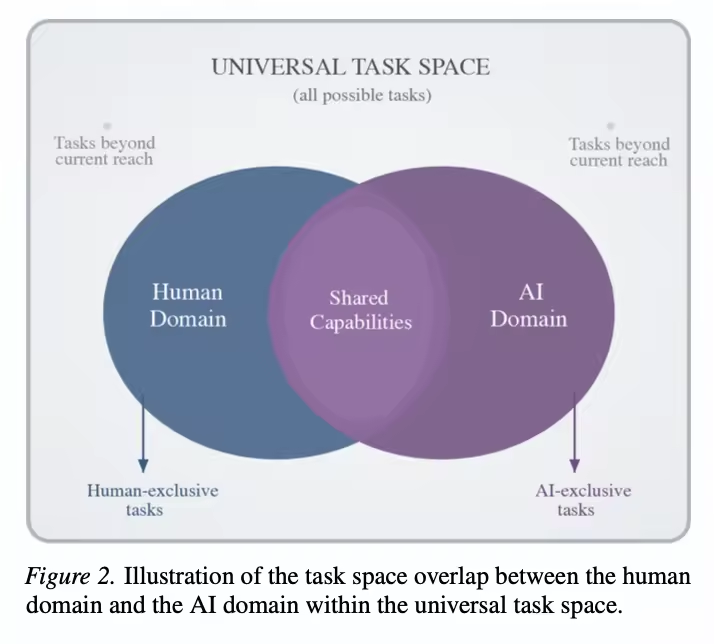

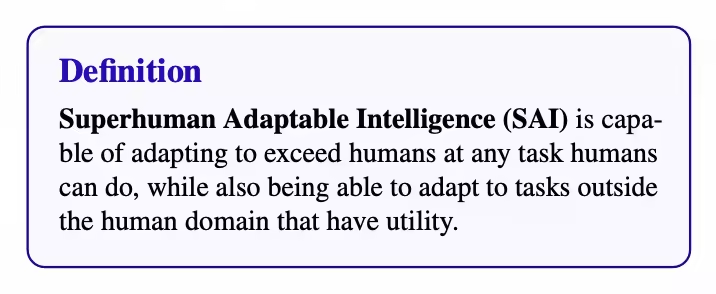

在批评完 AGI 之后,论文提出了自己的替代方案:超人类适应性智能(Superhuman Adaptable Intelligence,SAI)。定义大致是这样的:SAI 是一种能够通过适应,在任何人类能做的重要任务上超越人类,同时也能适应人类能力范围之外的有用任务的智能。

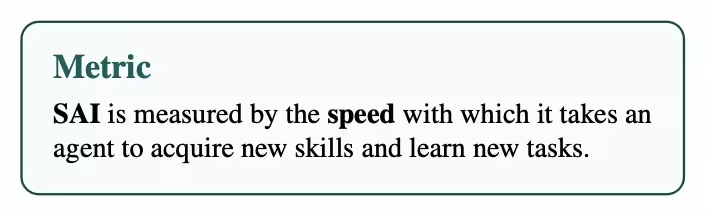

和 AGI 相比,SAI 有几个关键的区别。首先,它不声称自己是「通用」的,避免了逻辑上的自相矛盾。其次,它关注的不是「能不能做」,而是「能多快学会做」,也就是把适应速度作为核心指标。第三,它明确把任务范围扩展到了人类能力之外——那些人类做不了但有实际价值的事情(比如高维统计推断、复杂系统建模)。

和 AGI 相比,SAI 有几个关键的区别。首先,它不声称自己是「通用」的,避免了逻辑上的自相矛盾。其次,它关注的不是「能不能做」,而是「能多快学会做」,也就是把适应速度作为核心指标。第三,它明确把任务范围扩展到了人类能力之外——那些人类做不了但有实际价值的事情(比如高维统计推断、复杂系统建模)。

在实现路径上,论文倾向于自监督学习(SSL)和世界模型。理由是:要快速适应各种任务,系统首先需要对世界有广泛而深入的先验知识,而自监督学习恰好是获取这种通用知识的有效手段。世界模型则提供了规划和零样本迁移的能力——有了对环境动态的内部模拟,系统就可以在没有见过的任务上直接「想象」出解决方案。

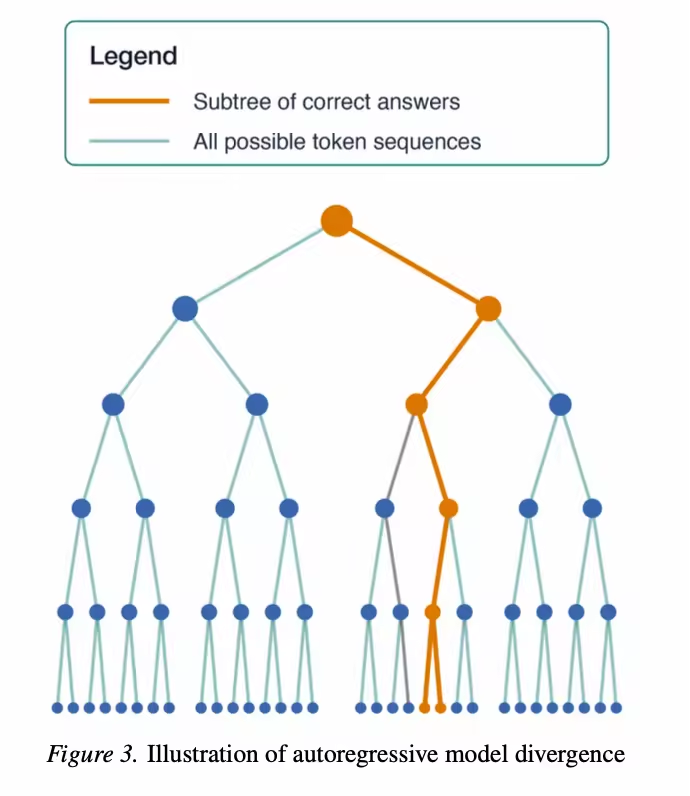

论文还特别提到了多样性的重要性。当前 AI 研究过度集中在自回归语言模型这一个范式上,这种同质化不仅可能减缓整体进步,也可能让整个领域陷入局部最优。SAI 框架天然鼓励不同的专精方向,有助于打破这种同质化。

在实现路径上,论文倾向于自监督学习(SSL)和世界模型。理由是:要快速适应各种任务,系统首先需要对世界有广泛而深入的先验知识,而自监督学习恰好是获取这种通用知识的有效手段。世界模型则提供了规划和零样本迁移的能力——有了对环境动态的内部模拟,系统就可以在没有见过的任务上直接「想象」出解决方案。

论文还特别提到了多样性的重要性。当前 AI 研究过度集中在自回归语言模型这一个范式上,这种同质化不仅可能减缓整体进步,也可能让整个领域陷入局部最优。SAI 框架天然鼓励不同的专精方向,有助于打破这种同质化。

Takeaway

在当前的 AI 热潮下,有这么一个反调,反而给了很多灵思,核心洞察其实并不新鲜,有没有特别强的干货,更多是一种思想实验。「人类不通用」「专精比全能更实际」这些观点在认知科学和进化生物学中有普遍共识。但论文的价值在于,它把这些观点系统地整合起来,对准了 AI 领域当下最热闹也最混乱的 AGI 叙事,提供了一个更务实的思考框架。 有一些可以商榷的地方。比如,论文对 AGI 定义的批评虽然条理清晰,但在某种程度上也没有讲清楚问题到底在哪:并非所有使用 AGI 这个词的人都真的相信「无所不能」的字面意思。很多时候 AGI 更像是一个方便的简称,指的就是「比当前 AI 强得多的下一代 AI」。另外,SAI 的定义里留下了开放问题,作者自己也承认没有给出精确定义。 SAI 还不是一个完美的理论体系,但至少它提醒了我们:与其争论 AGI 到没到、什么时候到,不如想清楚我们到底希望 AI 变成什么样。